从“聊天便宜”变成“Agent便宜”!DeepSeek-V4把大模型价格战推入“Agent时代”

每经记者|兰素英 每经编辑|王嘉琦

等了15个月,今天(4月24日),DeepSeek-V4(预览版本)终于发布了,而且是在OpenAI发布GPT-5.5几个小时后。

在约1000字的DeepSeek-V4产品介绍文章中,Agent(智能体)一词出现了多达11次。

DeepSeek-V4用专家模式(Pro)和快速模式(Flash)双版本配置,将大模型价格战从“聊天便宜”推进“Agent便宜”时代。

DeepSeek-V4凭借全新稀疏注意力与同策略蒸馏技术,把推理成本压到新低,V4-Flash版输出价仅为GPT-5.5 Pro的1.55‰,V4-Pro版性能比肩全球顶级闭源模型。

“低价快模型 + 高价强模型”组合,让DeepSeek-V4打通了Agent规模化落地的成本账。

全球模型对比:DeepSeek-V4实际价格到底多便宜?

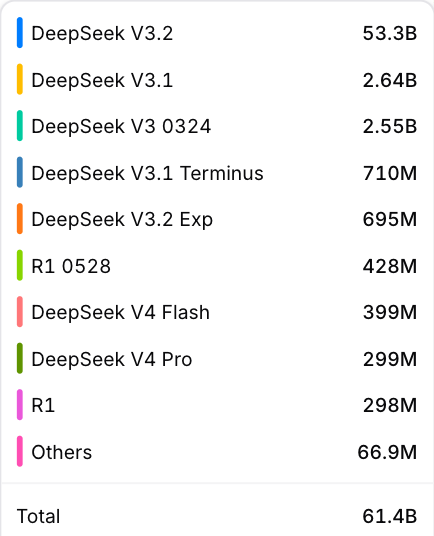

DeepSeek-V4发布后不久,全球最大AI模型应用程序编程接口聚合平台OpenRouter上,就已经有用户进行了调用。截至4月24日15点,OpenRouter平台上DeepSeek-V4-Pro的调用量达到2.99亿Token,V4-Flash调用量达到3.99亿Token。

DeepSeek延续了一贯的“普惠”风格。

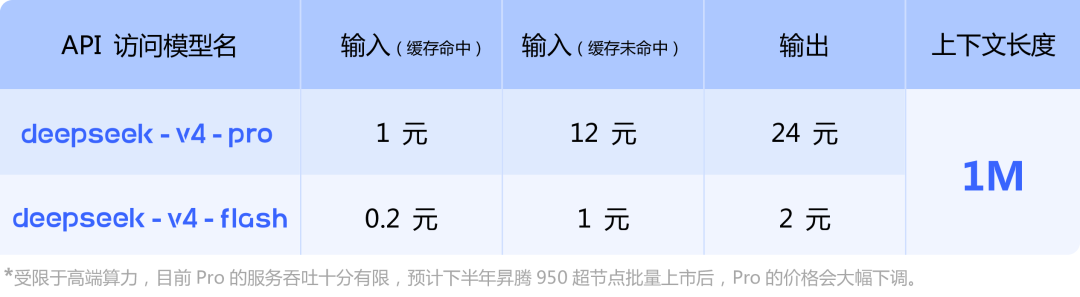

V4-Flash:缓存命中输入0.2元/百万Token,缓存未命中输入1元/百万Token,输出2元/百万Token。

V4-Pro:缓存命中输入1元/百万Token,缓存未命中输入12元/百万Token,输出24元/百万Token。

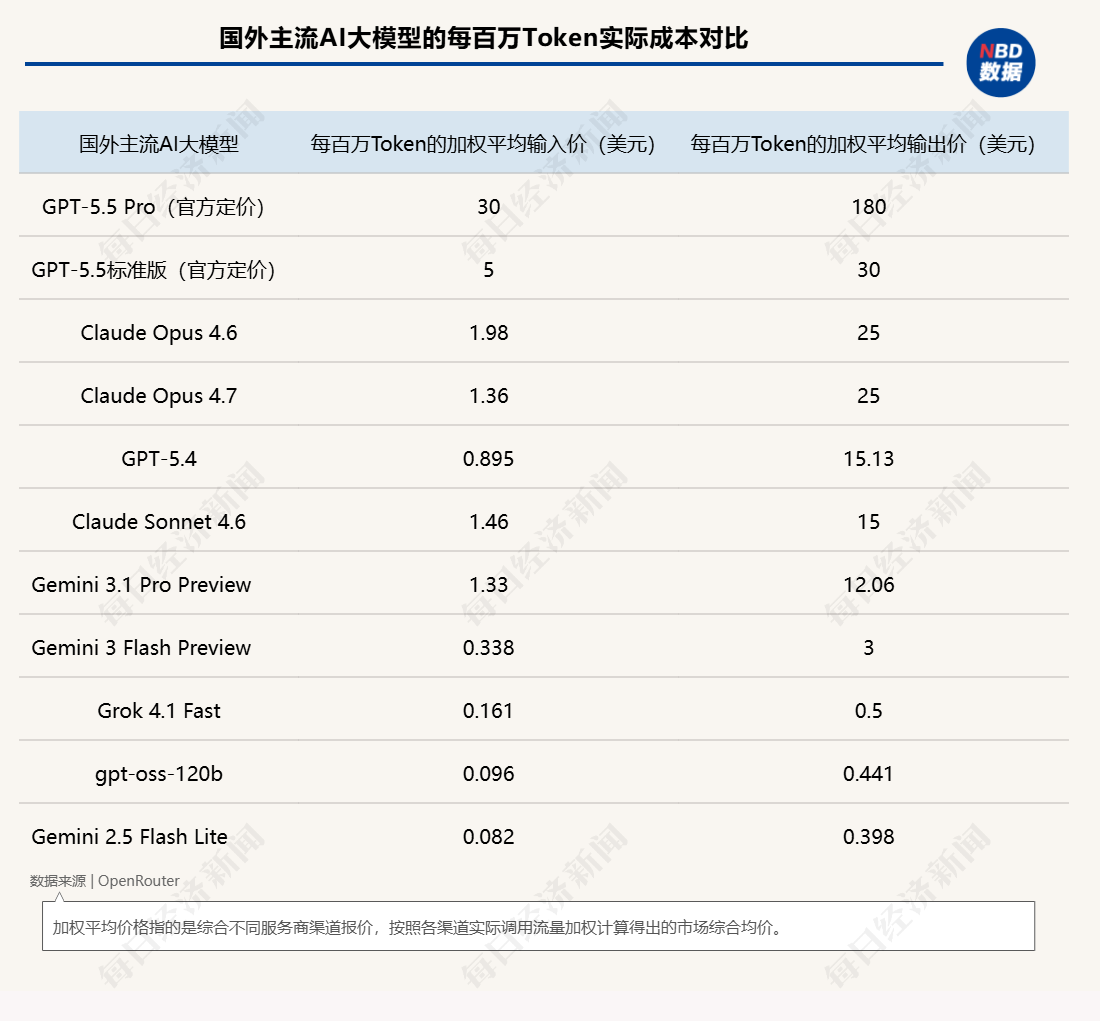

然而,不同于公司官方的API定价,OpenRouter平台会综合不同服务商渠道报价,按照各渠道实际调用流量加权计算得出的市场综合均价,也就是实际使用价格,该价格也会随时变动。

《每日经济新闻》记者统计OpenRouter数据发现,截至4月24日13:30,本周调用量领先的国内外主流AI大模型中,DeepSeek-V4-Flash的成本优势突出,每百万Token的平均输出价低至0.279美元,仅为OpenAI新发布的GPT-5.5 Pro(180美元)的1.55‰。

Anthropic Claude Opus系列、OpenAI GPT-5.4,以及谷歌Gemini 3.1 Pro Preview等大模型的输出价格均在12~25美元区间,是DeepSeek-V4-Flash的数十倍。

在输入端,DeepSeek-V4-Flash每百万Token平均输入价仅为0.07美元,只略高于阶跃星辰Step 3.5 Flash的0.031美元,显著低于其他国内外主流大模型。

值得一提的是,业界一直在关注DeepSeek-V4是否会使用国产算力。DeepSeek在产品介绍文章中用小字表示,受限于高端算力,目前V4-Pro的服务吞吐十分有限,预计下半年昇腾950超节点批量上市后,V4-Pro的价格会大幅下调。

DeepSeek-V4是如何实现低价的?

DeepSeek在58页的技术报告《DeepSeek V4:迈向高效的百万Token上下文智能》提到,V4开创了一种全新的注意力机制,在Token维度进行压缩,结合DSA稀疏注意力(DeepSeek Sparse Attention),相比于传统方法大幅降低了对计算和显存的需求。

这条路线和V3.2是一脉相承的。V3.2-Exp去年9月第一次引入DSA时,就把推理成本腰斩过一次。

真正让V4和V3.2在方法论上分岔的,是post-training(后训练)。技术报告中提到,V3.2的mixed RL(混合强化学习)阶段在V4被整体替换成了 On-Policy Distillation(同策略蒸馏)。

新的流水线分两段。先分别训练几十个领域专家模型,覆盖数学、代码、Agent、指令跟随,产出一个在各个领域内极强的“偏科生”。

在第二阶段,把十几个“教师模型”蒸馏到一个“学生模型”里。这种“先分头培养专家、再合并成通才”的路线,DeepSeek在报告里直接点名参考了思维机器实验室去年10月的on-policy distillation工作。

DeepSeek-V4的Agent账本:简单任务调用V4-Flash,高难任务调用V4-Pro

AI的使用场景已经从对话进入Agent。

OpenRouter与a16z联合发布的《2025 AI使用报告》覆盖超100万亿Token的匿名元数据,里面有一组数据极其关键——编程任务的Token占比从2025年初的11%飙到了50%以上,成为平台最大的单一使用品类。同时,Agent驱动的工作流产生的输出Token已超过平台总输出的一半。

过去的问答式AI,一轮对话消耗几百到几千Token,用户不再提问,Token就不会再消耗。Agent模式下,机器可以持续在后台跑流程。极端假设Agent全天候运行,每天吞掉数十亿Token。

因此,中国开源模型阵营几乎所有头部玩家都把Agent作为主攻方向,从架构到训练全链路为Agent场景做原生适配。

但光便宜不够,在这一轮真正拉开差距的,要在Agent场景下“跑得好”。

在此背景下,DeepSeek-V4似乎正是为Agent而研发的。DeepSeek在1000字的V4产品介绍文章中,Agent一词出现了多达11次。

价格较高但能力强的V4-Pro与快捷高效且价格便宜的V4-Flash的组合拳,恰好符合Agent的场景。

DeepSeek称,V4-Pro性能比肩顶级闭源模型,而V4-Flash是更快捷高效的经济之选。

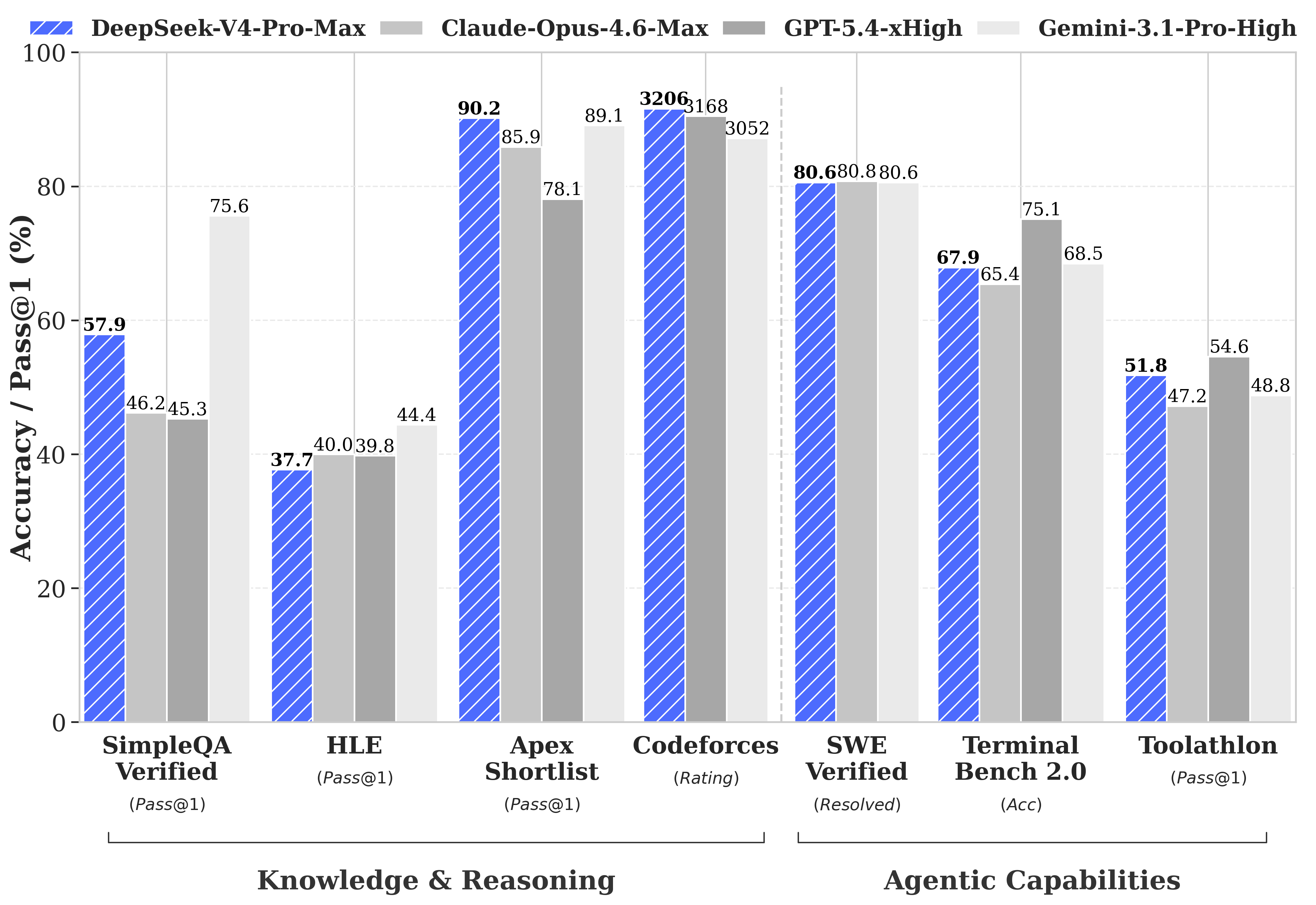

● Agent能力:相比前代模型,DeepSeek-V4-Pro的Agent能力显著增强。在Agentic Coding评测中,V4-Pro已达到当前开源模型最佳水平,并在其他Agent相关评测中同样表现优异。目前DeepSeek-V4已成为公司内部员工使用的Agentic Coding模型。

● 世界知识:DeepSeek-V4-Pro在世界知识测评中,大幅领先其他开源模型。

● 推理性能:在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro超越当前所有已公开评测的开源模型,取得了比肩世界顶级闭源模型的优异成绩。

相比V4-Pro,V4-Flash在世界知识储备方面稍逊一筹,但展现出了接近的推理能力。而由于模型参数和激活更小,相较之下V4-Flash能够提供更加快捷、经济的API服务。

在Agent测评中,DeepSeek-V4-Flash在简单任务上与DeepSeek-V4-Pro旗鼓相当,但在高难度任务上仍有差距。

普通任务调用V4-Flash等低价模型,高难任务才调用V4-Pro。对DeepSeek来说,未来不是单纯比谁最强,而是比综合任务成本。

所以,V4-Flash的意义不是“便宜一点”,而是把Agent场景,变成可以算账的生意。

免责声明:本文内容与数据仅供参考,不构成投资建议,使用前核实。据此操作,风险自担。

封面图片来源:兰素英

相关文章阅读

栏目最新文章

- 以定投筑生态 以长期赢未来——深交所举办“定投中国”ETF定投策略交流会

- 中金财富运营与客服中心执行负责人王云峰:定投正成为普通投资者穿越周期、践行长期主义的有效路径

- ETF今日收评 | 港股信息技术、科创芯片等ETF涨超3%,通信相关ETF跌约4%

- 深交所举办“定投中国”ETF定投策略交流会

- 年度业绩首亏、IPO募投不达预期,创益通拟定增6亿加码连接器业务,近一年股价涨超140%

- 创业板深化改革红利密集释放 制度包容护航新质生产力“跑出加速度”

- 国泰海通证券财富平台部总经理毕志刚:ALL in AI,重塑ETF定投全旅程

- 不在片刻,功在长远!一图速览“定投中国”深交所ETF定投策略交流会精彩观点